OpenAI的ChatGPT引爆了生成式AI技术潮流,在很长一段时间里一直被绝大多数人认为是最聪明的AI工具。随着时间的推移,一波从OpenAI出走的人创立了Anthropic,它所开发的Claude模型,在编程和企业应用领域占据明显优势。

截止到2026年3月,有人说OpenAI的ChatGPT依然很强,也有人说Anthropic开发的Claude系列模型跟能满足自己的需求,智能水平更高,两拨人争得不可开交。到底要用哪个呢?亚马逊云科技的答案是:我两个都要!

北京时间2月28日,亚马逊宣布将向OpenAI投资500亿美元,亚马逊云科技将成为OpenAI Frontier的独家第三方云分发提供商,意味着亚马逊云科技的用户能同时亚马逊云科技云平台上使用Claude和GPT系列闭源先进模型了。

此前,亚马逊云科技的Amazon Bedrock上架了OpenAI的开源模型,但双方并没有实质性的技术合作,因为任何人都可以部署这些开源模型,而这次,OpenAI把自家闭源的商业大模型放到亚马逊的平台上。

亚马逊总裁兼CEO Andy Jassy表示:“通过让OpenAI入驻Amazon Bedrock,并利用Amazon Trainium实现30%至40%的性价比提升,这在AI领域至关重要。这不仅是一段强有力的长期伙伴关系,也将为Amazon带来优厚的回报。”

OpenAI模型上架,亚马逊云科技集齐了业内最强模型

此前,微软凭借早前与OpenAI的投资关系,在早期占尽了优势。亚马逊则是通过与Anthropic的合作占据另外一块阵地,可以调用除了GPT以外几乎所有顶级模型,强调能为用户提供丰富多样的选择,现在,终于完整了。

OpenAI Frontier是OpenAI推出的企业级AI平台,它不仅会集成GPT系列大模型,还支持让企业不用自己搭复杂基础设施,就能快速把一群AI Agent接入到真实业务系统里一起工作,并且还能统一管理、安全可控,让企业成为AI原生的企业。

显然,OpenAI是要用OpenAI Frontier更好地服务企业级用户,而亚马逊云科技在企业级领域的优势积累非常明显。Anthropic也正是因为与亚马逊云科技的合作,在企业级市场占据了一些额外优势。

值得留意的是,“亚马逊云科技将成为OpenAI Frontier的独家第三方云分发提供商”,独家意味着,未来会有一些模型或者服务只在亚马逊云科技和OpenAI自己的平台上提供,而不会同步到其他平台,比如Azure上,这是一个微妙的细节。

Gartner称“该协议扩展并延续了OpenAI此前在亚马逊云科技上运行工作负载的承诺,并使其成为全新OpenAI Frontier独家第三方云分发提供商。应用和AI领域的领导者必须评估这一极具吸引力的新组合,以制定其企业AI战略。

OpenAI模型将大规模运行在Trainium芯片上,需要两座核电站供电

值得广大用户注意的是,这次合作中,OpenAI将通过亚马逊云科技的基础设施使用约2吉瓦的Amazon Trainium算力。2吉瓦电力什么概念?现在大多数正在运行的商用核反应堆的电力等级平均约1吉瓦,2吉瓦相当于需要2个核电站给它供电。

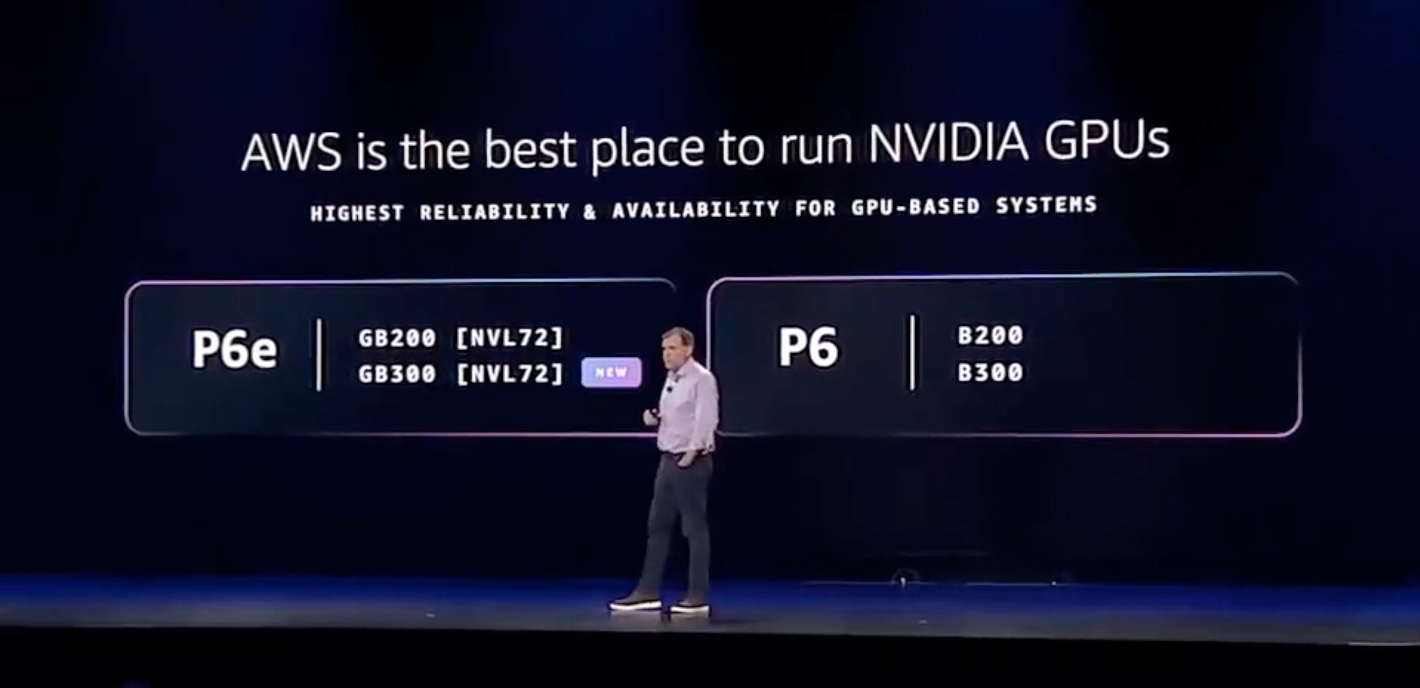

换言之,OpenAI会大量使用亚马逊自研的Trainium AI芯片,亚马逊云科技虽然部署了大量的英伟达显卡,但也在力推自研的AI芯片。OpenAI也希望底层芯片硬件的多元化,而不是绑死在英伟达的显卡上,亚马逊云科技与OpenAI在这方面很有默契。

OpenAI会使用目前的Amazon Trainium3和下一代Trainium4芯片。预计于2027年开始交付的Amazon Trainium4将带来重大性能提升,包括显著提高的FP4计算性能、扩展的内存带宽以及更大的高带宽内存容量。

虽然资料没提到是否用于训练,但肯定会大量用于推理,Trainium主打性价比,预计将带来30%至40%的性价比提升,意味着调用亚马逊云科技上的GPT系列模型会更便宜,这会吸引非常多用户接入由Amazon Bedrock托管的OpenAI服务。

双方手降低AI成本,会让Amazon Bedrock成为非常有吸引力的服务,用户可以在这里快速构建AI应用和AI Agent,随时切换GPT、Claude以及DeepSeek、Qwen、LLama等领先的开源模型,并利用各种成熟的安全合规手段把它用在企业环境中。

OpenAI联合创始人兼首席执行官Sam Altman表示:“将OpenAI的模型与亚马逊的基础设施及全球布局相结合,有助于我们将强大的AI真正大规模地交付到企业和用户手中。”

与OpenAI的深层次技术合作

双方还宣布正在联合开发一种由OpenAI模型驱动的“有状态运行时环境”,未来将通过Amazon Bedrock来提供。它使智能体能够记录、检索并从历史的交互经验中进行学习,从而在面对复杂的业务决策时,表现出随时间推移而不断优化的判断力,为啥这事儿很重要呢?

现在大部分AI模型的用法都是无状态的。在这种模式下,大模型不具备任何内生的长期记忆,它不知道前一分钟用户下达了什么指令,不清楚上一步调用了哪个外部API工具,更无法掌握一个包含十几个步骤的复杂企业审批流目前进展到了哪一个节点。

无状态的模式非常适合于面向消费者的一次性问答,比如简单的文本润色任务。而且无状态API在经济成本上具有显著优势。因为它不需要庞大的数据库来维持会话对象和状态存储,访问量比较大的时候,两种方式在使用成本上会有很大差距。

当把AI引入企业应用,当企业业务流程需要跨越CRM、ERP、财务审批系统,且中途需要等待人类介入审批等流程时,无状态架构的局限性便暴露无遗。为了弥补这一缺陷,开发团队不得不手动构建和管理上下文记忆,在企业环境中部署这套东西的难度会非常大,总之很麻烦。

现在,Amazon Bedrock的AgentCore Memory功能可以提供这种有状态的运行时环境,把这套麻烦的事情外包给了亚马逊。这套运行环境会针对亚马逊云科技的的基础设施进行优化,这样企业构建的AI应用和AI Agents,就可以和现有的云系统、业务应用更紧密地协同工作。

此外,OpenAI与亚马逊云科技还要联合开发定制化模型,用于直接面向消费者的AI产品和Agents。亚马逊自己也有Amazon Nova模型,即使双方合作开发模型也并不会放弃自家模型,亚马逊要让多种模型形成互补的关系。

Andy Jassy表示:“我们有众多开发者和企业都希望在亚马逊云科技上运行由OpenAI模型驱动的服务,而我们与OpenAI的合作所打造的‘有状态运行时环境’,将为构建AI应用和Agent的客户带来更多可能。”

结束语

亚马逊与OpenAI的合作,本质上是一场云计算巨头与模型巨头的相互成就。亚马逊出基础设施,OpenAI出大模型能力,企业不再需要在不同平台之间反复跳转,就能在同一个环境里直接构建和运行AI应用,加速AI的落地。

AI市场的竞争,拼模型的智能水平,也拼成本优势。亚马逊这笔投资,本质上是在用自研芯片和深度优化的运行环境,把OpenAI的能力真正推向更多企业——让AI不再是少数人的特权,而是多数人用得起的工具。