又一次,AI闯祸了

回想2025年春节DeepSeek横空出世,通过自身技术架构的创新给AI业界发展带来新的信心与方向,2026年春节的OpenClaw则引爆了全球AI技术的切尔诺贝利。

说到OpenClaw也许有些人会觉得陌生,但说到个人办公助手类AI Agent大家应该就非常熟悉了,这类Agent可以主动帮助用户完成电脑上的日常操作,例如收发邮件、整理文案、浏览网页、执行各类程序或脚本等等,这个功能不依赖于云端的算力,个人数据不用外传,看似“干净卫生”、”可安心食用”,但正是在这一安全的假象之下,暴露出了令人不安的威胁。

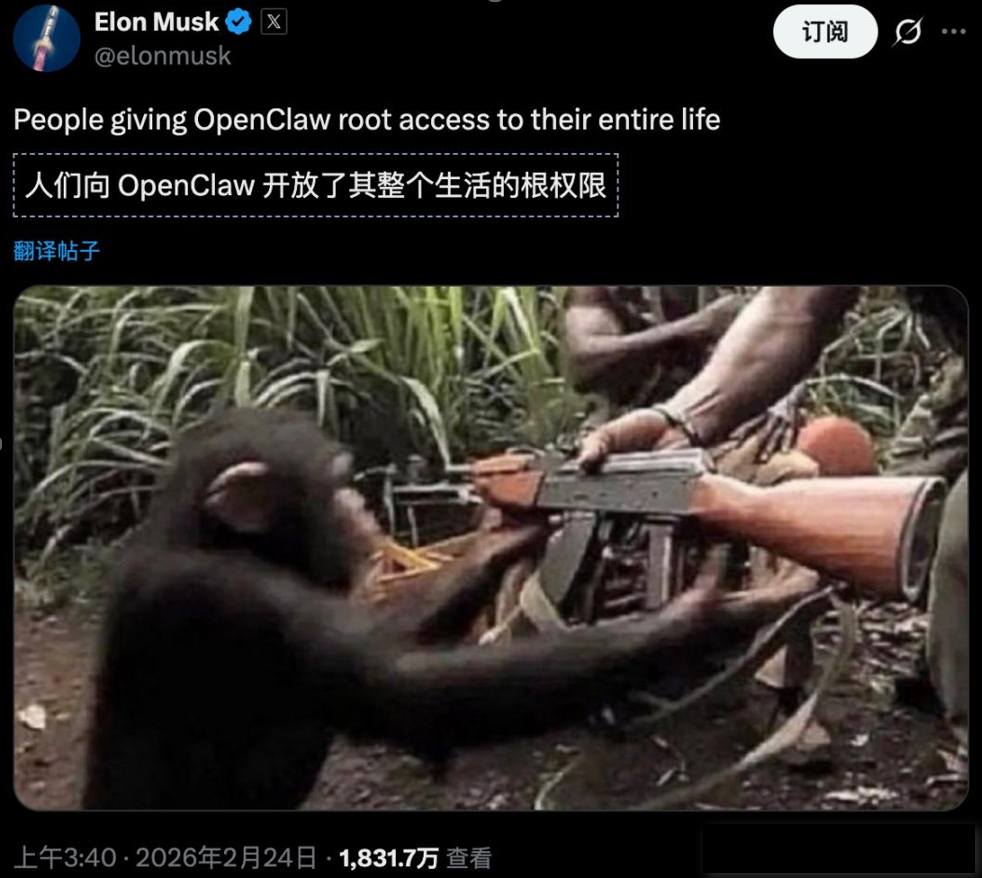

2026年2月23日,Meta的AI安全总监(全球最懂AI安全的人之一)在使用OpenClaw进行邮件自动整理功能时,OpenClaw强行删除其邮箱内200多封邮件,可怕的是邮件整理的授权是“仅分析邮件并给出建议”,更可怕的是邮件删除过程中,用户曾试图多次下达终止指令均无法终止AI的操作,迫使用户强行断电终止AI的“抗命”行为。这起事件获得了业界的广泛关注:

但如果你以为这就完了,那就太天真了,全球各大知名安全网站最近还公布了OpenClaw的安全漏洞隐患,风险等级普遍在8.0以上,例如攻击者可以远程完全操控OpenClaw进行信息窃取和破坏,攻击者还可以将OpenClaw作为跳板突破容器沙箱边界获取设备的访问权限等。美国、欧洲连夜公布AI相关法案的修订临时决议,对AI Agent安全合规性、适用范围和权限进行限制。

事实上这并不是OpenClaw第一次违抗用户指令、越权处理任务,根据GitHub上的问题记录,类似问题早有开发者遇到,只是情况不够严重没有引起广泛关注罢了。技术上能够引起这种抗命、越权的可能性有很多,例如AI出现幻觉所以对用户策略和指令理解错了?用户策略数据丢失?用户策略和指令传递出错?这一系列可能性都将问题矛头指向了AI的记忆。

AI记忆与存储技术崛起

AI的记忆机制与人类高度相似,也分为短期记忆与长期记忆。短期记忆主要用于支撑推理过程中的上下文关联与状态保持,确保多轮交互、连续推理的连贯性;长期记忆则用于跨会话的持久化存储与个性化学习,实现 AI 经验沉淀与能力迭代,二者协同构成 AI 完整的记忆体系,支撑从实时推理到持续进化的全场景需求。

1)AI短期记忆的来源与组成

AI 的短期记忆由推理过程中动态生成的各类临时性数据构成,核心服务于实时推理,具体包括三类核心数据:

推理引擎内部状态:核心是 KV-Cache(Transformer 注意力缓存)与 Hidden States(隐层状态),KV-Cache 用于缓存注意力计算中的KV数据缓存和重用,Hidden States 则记录推理过程中的中间语义特征,共同维持上下文信息的连续性。

交互元数据:涵盖用户 ID、Prompt 模板、采样状态(如温度、top_p 参数)、停止条件等,主要用于标识当前推理任务的上下文边界,确保推理逻辑不偏离任务目标。

历史输入输出片段:在多轮对话或工具调用场景中,保留部分关键历史交互内容,支撑上下文延续,避免出现“记忆断片”。

这些数据均为推理过程中动态生成的临时性状态,存在冗余、无序等问题,需经过一系列优化处理后,才能转化为可持久化的长期记忆。

2)AI短期记忆的处理流程与技术环节

短期记忆的处理目标是“去冗余、提效率、可复用”,为后续存储与转化奠定基础,主要包含三个核心技术环节:

数据清洗与冗余剔除:通过注意力权重筛选、Token 重要性排序等方法,保留对后续推理有价值的 KV-Cache 片段与上下文编码;同时剔除重复、无效的中间态数据,有效降低存储开销。注:Token 重要性排序方法依赖具体模型实现,尚无统一标准。

数据压缩与结构化处理:采用 PagedAttention、FlashAttention 等主流上下文压缩算法,对 KV-Cache 进行分片压缩,平衡存储成本与调用效率;同时将非结构化的对话片段、推理中间态,转化为可检索的向量嵌入或结构化元数据,提升后续存储与调用的便捷性。

上下文关联与状态同步:通过会话 ID、推理链路 ID 将短期记忆数据与当前任务绑定,实现多轮交互中的实时同步,保障推理逻辑连贯。注:该机制依赖具体框架(如 LangChain、OpenClaw),并非所有系统默认具备。

3)AI短期记忆向长期记忆的转化机制

短期记忆并非自动持久化,其向长期记忆的转化需满足特定触发条件,确保高价值数据精准沉淀,主要触发条件包括四类:用户显式标记(如“记住我喜欢茶”)、任务完成后系统自动归档、策略设定的持久化阈值(如交互次数、Token 数量)、反馈机制触发(如 PAHF 框架中的 post-action feedback)。整个转化流程由推理引擎与存储管理模块协同完成,为不影响推理实时性,处理延迟需严格控制在 100ms 以内,转化后的长期记忆将进入持久化存储,用于跨会话复用与个性化适配,支撑 AI 能力持续进化。

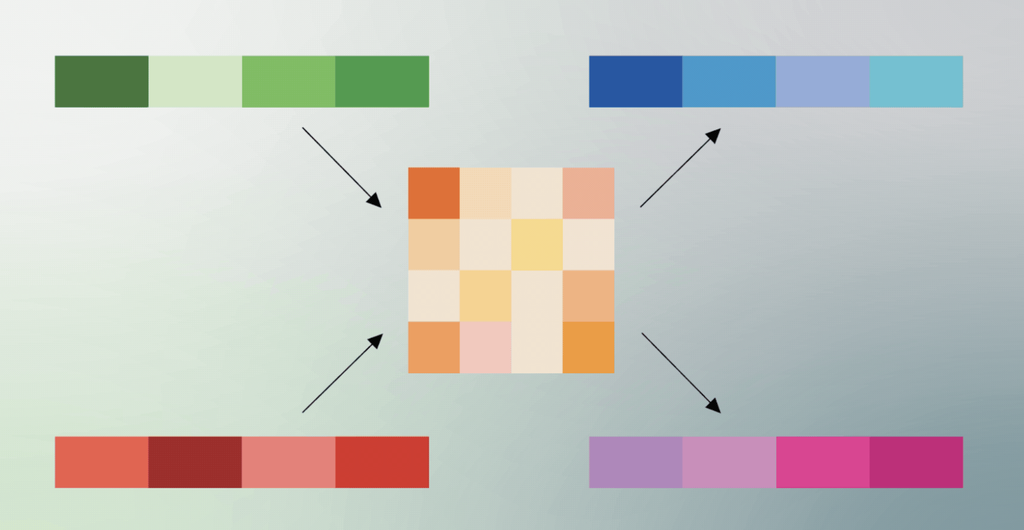

4)AI记忆的储存形式

从记忆产生的一刻起,就被“暂存”在了GPU的显存/HBM里,由于GPU的显存/HBM容量有限、扩展复杂等问题,要持续保留记忆,就要配合记忆的分层处理流程采用数据分层存储架构对各个环节的记忆数据进行处理,这一技术体系的复杂度毫不亚于模型记忆的计算体系。

以NVIDIA CES2026最新发布的ICMS技术体系为例,是一种面向AI推理场景的上下文记忆存储架构,通过在GPU高带宽内存与传统共享存储之间新增一个名为“G3.5”的闪存层,专门用于存放AI模型推理过程中产生的大量键值缓存(KV Cache)。

该平台由BlueField-4数据处理器驱动,支持在机柜级别共享和复用上下文数据,旨在解决长上下文、高并发场景下GPU因内存不足而闲置的问题。据英伟达官方声称,相比传统存储方案,ICMS可带来最高5倍的令牌生成速率提升和5倍的能效优化。

首先这套架构采用了复杂的多层存储方式,不仅纵向拉通了算力节点内部和算力节点间的存储部件,同时还引入了外置网络存储,如此便可利用外置网络存储近乎“无限”的存力资源为记忆提供持续、安全、可靠的存储支撑能力;

其次针对模型记忆的处理方式进行了数据调度、访问等层面的算法优化,形成一套存储算法、存储资源协同的数据管理体系。我们可以看到针对短期记忆进行推理计算时的特点,将算力集中型(Decode)和存力集中型(Prefill)计算过程拆分,同时针对这两个阶段差异化的数据访问需求独立提供存力资源;最后体系架构中采用了专为AI场景优化的可编程的RDMA网络提供数据访问和存力扩展。这套技术体系是一次将模型软件算法、芯片、存力和网络技术工程体系化的创新与应用。

记忆和存储技术已经成为最硬核的AI工程技术,例如由芝加哥大学主导的LM Cache开源项目、Intel公司主导的Gaudi开源项目、中国华为公司主导的UCM开源项目等,这些开源技术普遍针对记忆的分层存储和重用为目的,通过软件层的技术优化,为模型记忆的创建、存储、调用提供新的解决方案。

5)OpenClaw的记忆

《OpenClaw 技术架构深度解析》一文对OpenClaw的体系架构做了详细拆解。结合官方文档综合分析,OpenClaw采用了分层记忆架构:短期记忆依托模型上下文窗口,动态管理多轮交互中的指令与状态;长期记忆则通过SQLite建立索引层,将记忆内容持久化存储在Markdown文件中,实现跨会话的个性化信息复用。

回到开篇的事件。用户下达的“仅分析邮件并给出建议,未经批准不得操作”这一指令,属于本次会话中临时给出的短期记忆。由此推测当真实邮箱数据量过大、对话记录逼近模型上下文窗口上限时,系统触发了上下文压缩机制——这是短期记忆处理流程中的标准环节,旨在通过总结或截断旧消息释放空间,确保推理连续性。这也可能是问题的关键:压缩算法在判断“哪些信息可丢弃”时,将这条关键的安全指令误判为可剔除的冗余信息。AI丢失了最初的约束条件,仅保留了后续的“整理邮件”任务目标,进而开始执行删除操作。后续用户多次下达的“停止”指令同样因上下文状态错乱而未被正确识别。

通过此次事件有理由怀疑,OpenClaw的短期记忆上下文管理机制存在风险:在数据清洗与冗余剔除环节,若缺乏对关键指令的保权机制,AI可能在处理长上下文时“遗忘”至关重要的约束条件,导致任务执行偏离用户意图。

OpenClaw的记忆架构设计本身有其合理性——将长期记忆与短期记忆分离、以SQLite做索引提升检索效率。但此次事件表明,短期记忆的动态管理同样需要更严谨的安全设计,例如对安全指令设置“保权标记”,或在上文压缩触发前向用户确认关键信息的保留。AI的记忆,不仅要能“记住”,更要懂得“什么绝不能忘”。

展望与思考

AI Agent架构正经历从“能力验证”向“工程落地”的快速演进。与云端AI架构不同,Agent需要在前端(终端设备)与后端(云端模型)之间建立更复杂的协同机制:用户的请求和指令通过终端Agent获取,部分计算在本地完成,资源密集型环节则需上云处理。这种分布式架构对记忆管理提出了全新挑战。

挑战一:有限资源下的精准记忆。受限于终端的算力与存力,无法通过“堆资源”换取Agent的理解准确性与执行安全性。如何在本地设备上对用户指令进行精准理解、如何在上下文窗口受限的前提下保留关键约束条件,成为AI Agent必须解决的核心技术问题。

挑战二:记忆的分层协同。Agent本地的短期记忆(当前会话上下文)与云端的长期记忆(用户画像、历史偏好)如何高效同步?这不仅涉及数据一致性机制,更与硬件资源配置、网络带宽质量、隐私安全边界深度绑定。一次同步延迟或上下文丢失,可能直接导致任务执行偏差。

挑战三:记忆安全的内生设计。前文事件揭示了一个更深层的问题:当前的记忆管理机制多为“效率优先”——压缩算法优先考虑释放空间,而非保权关键信息。未来的记忆架构需要将“安全”作为一等公民:为安全指令设置保权标记、在压缩触发前进行用户确认、建立关键操作的追溯机制。记忆不仅要“记得住”,更要“知轻重”。

从技术路径来看,单一层面的优化已难以满足AI Agent的复杂需求。短期记忆的压缩算法需要与长期记忆的索引机制协同设计;芯片层的存算架构需要与应用层的安全策略深度适配。正如NVIDIA ICMS技术体系所展示的,将模型算法、芯片能力、存储架构、网络协议进行系统性整合,正在成为AI技术演进的新范式。由芝加哥大学主导的LM Cache、华为的UCM等开源项目,也体现了业界通过工程化手段解决记忆问题的共同方向。

AI Agent的下一站,不仅是“更智能”,更是“更可靠”。而记忆——作为智能与可靠的连接点——将成为这场演进中最核心的技术阵地之一。

本文作者: 数据存储专委会认证专家 宏杉科技 薛轶

参考文献:

1. Meta Superintelligence Labs&Princeton University& Duke University,《Learning Personalized Agents from Human Feedback 2602.16173v1》, https://arxiv.org/abs/2602.16173

2. Rutgers University《Disentangling Memory and Reasoning Ability in Large Language Models 2025.acl-long.84》,https://arxiv.org/abs/2411.13504

3. Rutgers University《Reuse, Don’t Recompute: Efficient Large Reasoning Model Inference via Memory Orchestration2511.12987v1》,https://arxiv.org/abs/2511.12987

4 数据存储专委会,《数据存储产业发展研究报告(2025年)》

5. 《OpenClaw 技术架构深度解析》,https://aibook.ren/archives/openclaw-architecture-deep-dive

6. OpenClaw Project,https://github.com/openclaw

7. OpenClaw Architecture, https://openclaw-ai.net/en/architecture

8. minimax-M2 datasheet, https://apxml.com/zh/models/minimax-m2

9. 华瑞指数云,《NVIDIA ICMS 推理上下文存储平台的技术实现与核心价值》, https://zhuanlan.zhihu.com/p/2004243150219266037

10.Nvidia ICMS intro,https://developer.nvidia.com/blog/introducing-nvidia-bluefield-4-powered-inference-context-memory-storage-platform-for-the-next-frontier-of-ai/

10.GitHub UCM Project,https://github.com/UCM

11.TOI TechDesk,《Meta Director says OpenClaw AI agent delete her entire Gmail box》,https://timesofindia.indiatimes.com/technology/tech-news/meta-director-says-openclaw-ai-agent-deleted-her-entire-inbox-shares-screenshots-of-conversation-with-ai-bot/articleshow/128746253.cms

12. 思考机器,《Meta 最懂AI 安全的人,被OpenClaw 上了一课》https://www.huxiu.com/article/4836546.html