谷歌今天面向大模型和向量搜索场景发布免训练压缩算法(ICLR 2026 论文)TurboQuant,号称能将kv cache(键值存储)使用容量降低6倍以上,同时部分场景性能提升8倍。

简单来说,在AI推理应用中,为了提升计算效率、支持上下文关联以及多轮问答,模型需要通过键值存储来不断存储中间结果,避免重复计算。但随着上下文长度增加,这部分存储会迅速膨胀,逐渐成为系统的核心瓶颈之一。

现在谷歌说,键值存储可以压缩,就是你可以用更少的内存记更多的事儿,发布一出引发存储市场股价波动,比如SK海力士股价一度下跌6.4%,铠侠跌幅也与之相近,还有美光等存储厂商都出现一定程度下跌。

不过,这种担忧未必成立。内存访问瓶颈的缓解,不等于内存需求下降。相反,如果真的能用,岂不是可以在更小的空间放更大的模型,以后手机和PC是不是也能跑得动一些之前不敢想的大模型?

首先我们先了解TurboQuant有什么用。

TurboQuant的核心目标是在几乎不损失模型精度的前提下,降低高维向量及键值存储的内存占用。相比之下,传统量化方法虽然可以压缩数据,但通常需要额外存储量化参数,会有一定的内存开销,像极了我的生活日常,边省钱边为了省而多花钱……

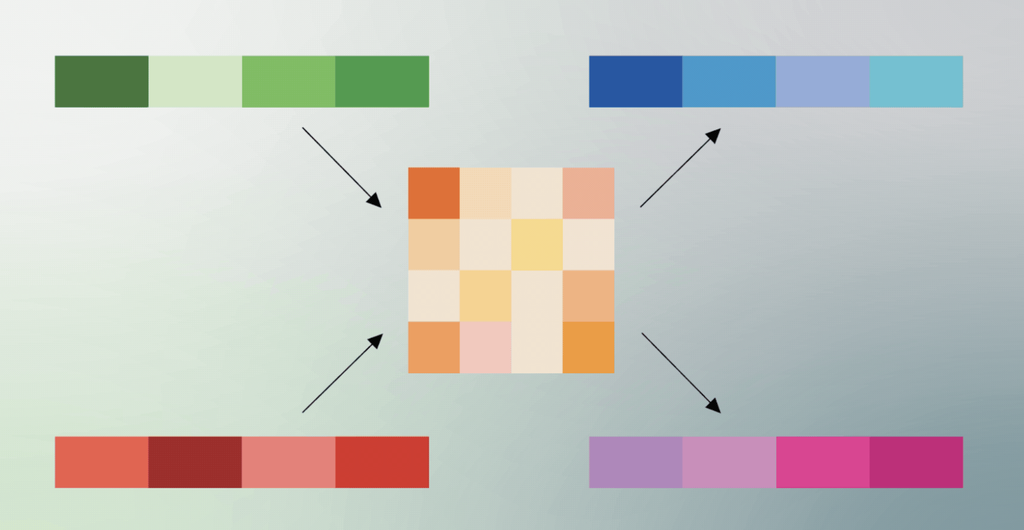

TurboQuant的改进在于,它在压缩的同时尽量减少额外成本。具体来说,TurboQuant首先通过PolarQuant将向量从传统坐标系转换为“方向+强度”的表达方式,使数据结构更易压缩;随后再通过QJL(Quantized Johnson-Lindenstrauss)利用极低(约1比特位)的信息对误差进行修正,避免传统方法中额外的内存负担,也就是帮我实实在在省钱。

根据谷歌博客显示,在长上下文任务实验中,TurboQuant在无需训练或微调的情况下,可将键值存储量化到3比特位,同时在保持模型精度基本不变的前提下,将键值缓存的内存占用降低至少6倍。

换句话说,即使内存被压缩,不影响记忆能力和检索能力,模型仍然可以在大量文本中准确找到关键信息。

不过,在性能方面,TurboQuant所说的最高8倍加速,不是整体推理性能提升,而是集中在Transformer中attention logits计算的环节。实验室在H100 GPU上,4比特位的TurboQuant在这个环节的性能相比32比特位未量化键值数据提升最高约8倍。原因不是算力增强,而是数据量少了,降低了内存访问压力。

如果从产业角度来看,谁会最先受益?

首先是大模型厂商。若该算法能用,其推理阶段的内存成本有望下降,降本增效。

其次是向量搜索与RAG相关场景。在这些应用中,高维向量规模巨大,压缩带来的不仅是存储成本下降,还包括检索效率的提升。

此外,本地AI部署也可能因此受益。当内存压力下降后,AI PC、工作站及企业级一体机运行大模型的门槛有望进一步降低。

但需要强调的是,效率提升不等于需求下降。反而我期待的是在单个模型更省内存,我们普通人在消费级市场是不是能更快的拥有一个更趁手的大模型。当然它也是影响单位token的系统成本下降的原因之一,能不能用,能不能用好,还要继续观察。