我们知道AI、也知道安全,相比,应用交付就不太好理解。

不理解没有关系,我们要了解一件事情:就是我们如何使用AI?一定透过API接口调用,这与调用微服务没有太大区别。换句话说,AI也是类似容器/微服务化方式提供服务。

可以认为:未来的世界就是各种AI编织服务的世界。

这样的一个世界,需要怎样的IT基础架构来支撑?都说,有图有真相!

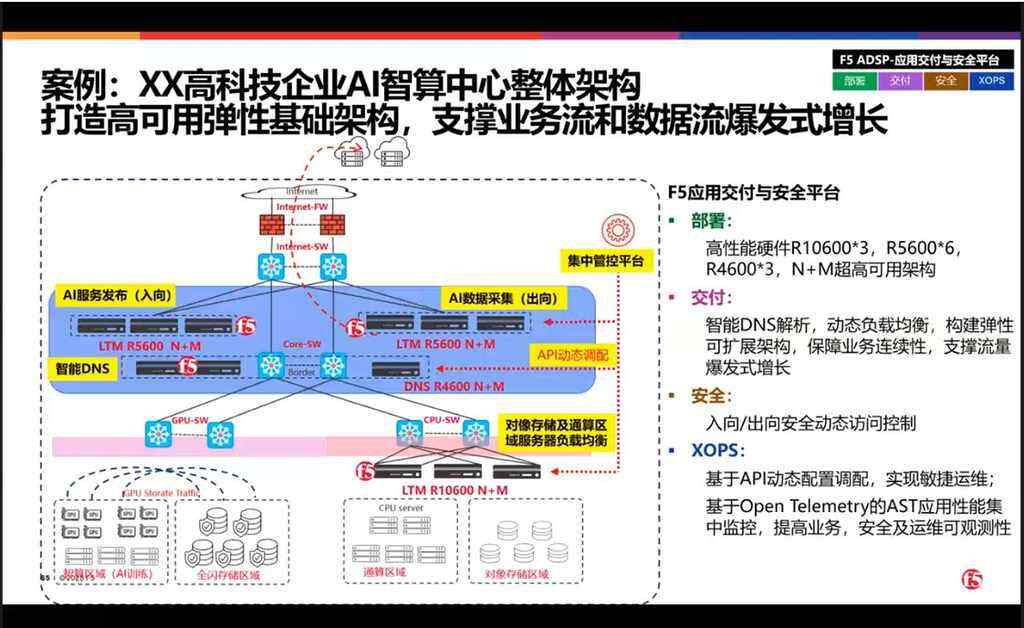

这是一个AI智算中心的典型架构,该架构从业务流、数据流的角度,揭示了AI智算中心的硬件设备构成,重点涉及流量接入、核心交换、应用交付、存储与计算等AI创新业务应用。

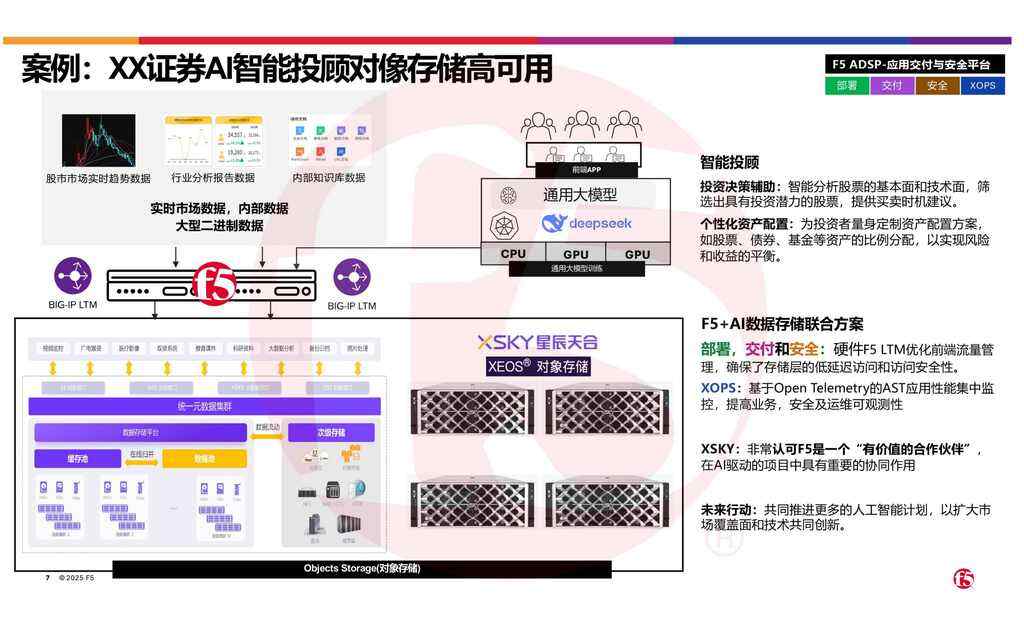

在此,我们可以结合具体看证券行业的一个AI应用案例。

如今,很多行业都接入了DeepSeek一体机,但是对于业务应用的帮助并不大,很多用户反馈,一体机的性能存在问题。

这里有硬件选型的问题,也有企业级安全管控的要求和限制的影响。此外,该案例中的证券公司要要让DeepSeek一体机能够结合股市行情、内部知识库,为投资决策提供顾问咨询和推理,其技术的重点是RAG(检索增强生成)系统应用,为了保障 该AI应用的可用性、性能与安全,该案例采用了F5 LTM(本地流量管理器)设备,不仅转发流量,更聚焦于负载均衡、后端服务器状态实时监测、隔离故障节点、拦截 SQL 注入/XSS 等 Web 攻击、SSL/TLS加密解密(卸载服务器负载)、保持会话一致性等。

这里的LTM 就是 “应用层的流量大脑”,相比网络交换机只是 “流量管道”。

为了让DeepSeek一体机发挥作用,就要发挥流量大脑的作用,不仅是企业级应用必备,也是安全重要保障。AI时代,流量管理的大脑也需要与时俱进,不仅考虑要承载连接的数量,更要对访问连接的内容进行判断,要结合任务复杂度、以及算力资源的性质/能力进行综合考量,以提升的AI应用的响应能力,物尽其用。

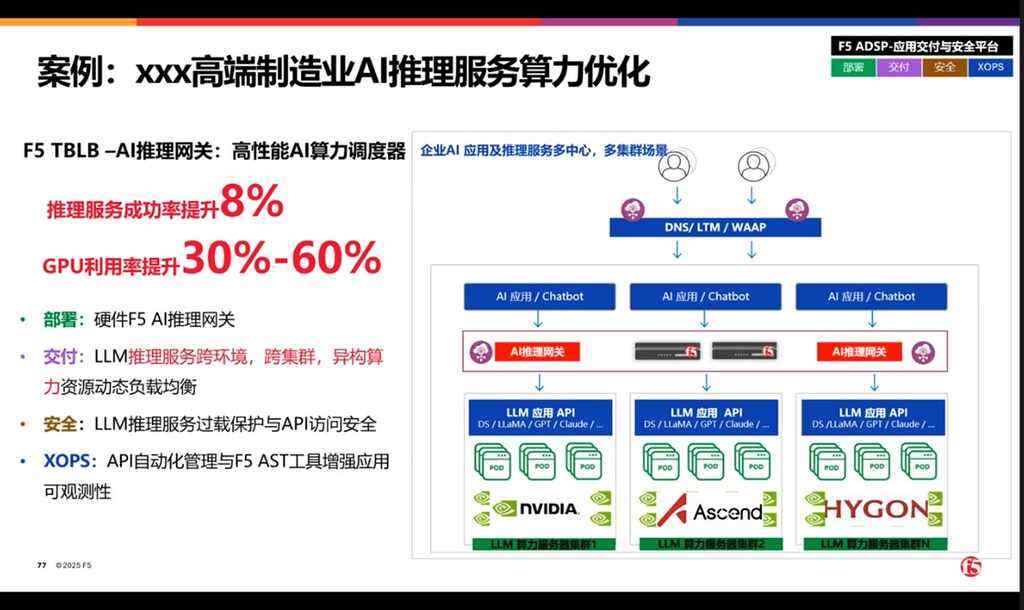

F5北亚区区域副总裁张振伦透露:其中的核心技术方案是F5 TBLB(Token Based Load Balance),也就是基于Token感知的流量分发,无论是推理还是训练,都会有不同的任务会分到后台服务器,不同的服务器计算能力不同,因为很多用户,特别是国内用户大多采用混合GPU架构,即使采用同一个品牌,也会有不同代产品的差别,传统基于SLB的流量分发没有办法感知后台。

新的F5 TBLB主动感知大模型实时状态,基于这些状态数据进行流量的分发和调度,为此F5做了大量的测试,从而得出结论:会有30%~60%GPU利用率提升,推理服务成功率提升8%。不要小看这些性能的改善,未来的AI业务应用,绝非依赖单一模型,而是众多模型协同努力工作的结果,将问题交给正确的模型处理,将会带来极大的效率提升以及成本节省。

对于模型访问的管理,甚至比模型推理本身还重要,其中的连接管理、LLM安全等不是大模型厂商的专长,需要应用安全交付厂商提供支持,术业有专攻。

全球Web软件应用安全组织——OWASP(Open Web Application Security Project,开放 Web 应用安全项目),特别列举了AI API访问的10大关键,涉及身份认证、授权、资源消耗等控制内容,可以成为AI业务创新应用运维的参考标准。

应用交付+安全,这就是全新ADSP(Application Delivery and Security Platform ,应用交付与安全平台)的核心内容。

张振伦表示:“作为业界首款将高性能负载均衡、智能流量管理与先进的应用及API安全能力深度集成于一体的平台化解决方案,ADSP将帮助企业有效应对AI时代的混合多云架构挑战,降低复杂性,提升安全性,并充分释放 AI 的业务潜能。”

据F5亚太区首席技术官Mohan Veloo透露:ADSP有多种产品规格和形式可供选择,如本地数据中心运行的高性能硬件、虚拟化形式,也有混合云环境中的软件形式,以及云原生环境的SaaS方案提交方式,既能够服务本地混合云环境应用,也能够满足企业出海的需求,实现跨环境的一体化运维与安全防护,为用户带来多重应用价值。

F5北亚区总裁黄彦文表示:“F5中国将坚守‘中国创新,服务中国’承诺,以应用交付与安全平台为核心,持续丰富AI方案组合;深耕本土市场,拓展汽车等重点行业与区域服务网络;携手渠道伙伴,共建开放共赢的合作生态,从而助力企业用户在AI时代赢取先机。”

抓住AI的契机,成为AI不可分割组成部分,有AI的地方,就有ADSP!