导读

近期,GPT-5相关消息不断,奥特曼公开谈体验,种种迹象显示其即将问世。然而,The Information曝光了更多内幕,被OpenAI视为迈向AGI关键一步的GPT-5,其实经历了不为人知的“难产”危机。这场危机涉及诸多致命问题,如核心项目受挫、人才流失、技术路线摇摆等,同时OpenAI还面临严峻的现金流危机,尽管年化收入暴增至120亿美元,但面对2025年高达80亿美元的预期现金消耗,急需GPT-5提振信心。GPT-5对OpenAI而言,已不仅是技术产品,更是一场豪赌。

今天,2025年8月4日,多方消息表明GPT-5可能将在未来短期内正式发布。这款承载着3000亿美元估值期望的AI模型,能否兑现承诺?

文字编辑|宋雨涵

1

GPT-5难产背后

重大事件盘点

GPT-5曾遇“脑死亡”困境:OpenAI内部曾寄予厚望的推理模型o3,在实验室中表现卓越,但转化为能与用户对话的模型时,性能大幅衰减,甚至不如上一代o1模型。原计划作为GPT-5的Orion项目也因技术瓶颈流产,最终以GPT-4.5名义发布。

开发过程波折不断:技术上遭遇“规模化诅咒”,高质量数据告急,一些在小模型上效果显著的训练方法,在模型规模扩大后失效。同时,核心研究员被Meta高薪挖走,团队动荡,士气低落。

“通用验证器”极限救场:在困境中,OpenAI开发出“通用验证器”系统,让一个AI扮演考官,检查评判另一个AI的答案质量。该系统不仅能验证有明确答案的领域,还能判断主观性更强内容的质量,为模型优化提供了高质量反馈数据,为GPT-5开发扫清障碍。

最终版本为模型家族:最新泄露的GPT-5是一个模型家族,包括全能主模型o3-alpha、专为编程设计的lobster等,首次实现了推理和多模态能力的统一。

烧钱豪赌未来:OpenAI年化收入飙升至120亿美元,ChatGPT周活破7亿,但预计2025年将烧掉80亿美元现金。GPT-5的成败将决定OpenAI的未来。

外界评价褒贬不一:奥特曼称GPT-5比所有人都聪明,而马库斯则列出“7大悲观预测”,提醒大家理性看待。

2

三重矛盾旋涡

行业巨人步履蹒跚

1

算力、数据与“智能天花板”的三重围剿

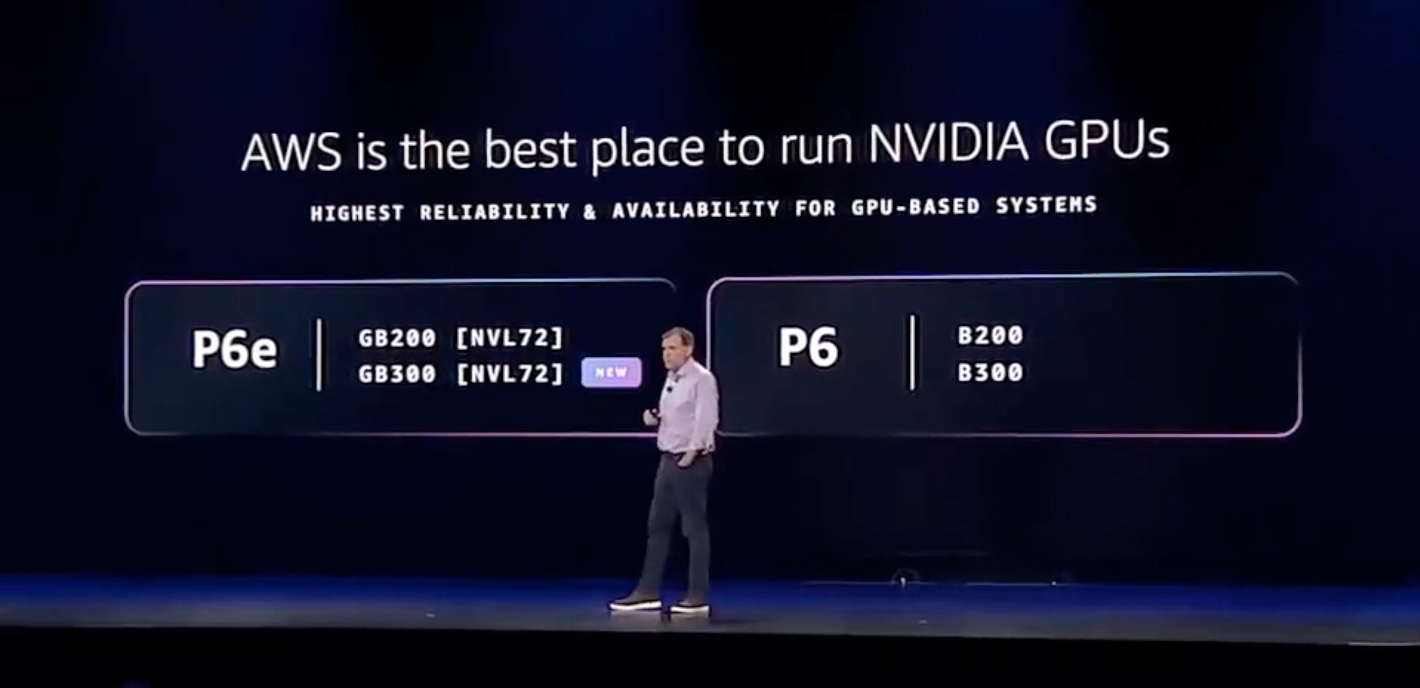

算力:电力、芯片双双逼近红线,OpenAI首席科学家萨茨克维多次坦言,模型的每一次跃升都依赖于算力的指数级增长。然而,GPT-5预期所需的训练算力预计将是GPT-4的数倍以上。

据高盛最新研究,在AI快速发展的高歌猛进中,美国数据中心电力需求在未来2年内激增近160%,而现有电网与输电设施难以为继。这种硬性束缚无异于给渴求算力的OpenAI“拔掉电源插头”。

数据:精料枯竭,成本“撑爆天花板”,大模型的胃口远超人类想象,但喂养它们的“知识营养源”却陷入枯竭。业界普遍认为,高质量互联网文本数据已被GPT-4训练时代“扫荡殆尽”。如今,专业付费知识库成了最后阵地,其成本飙升令人窒息。麻省理工研究报告直指模型训练成本呈20倍增长之势,让“数据饥荒”成为压垮规模扩张的最后一根稻草。

智能天花板:创新陷入边际效益陷阱,更关键的是,模型智能在经历早期的跳跃增长后,开始触碰到肉眼可见的天花板。当前模型虽能逻辑推演,但对抽象长链推理、跨模态思维整合、以及“自我反思验证能力”存在深度盲点。业内专家评价GPT类模型为一种“模糊拼凑智能”——其输出的“思维幻觉”频次并未因模型增大而显著减少,反而在复杂场景中更易暴露短板。

算力不足已并非单一公司之困,而是对行业基础设施的一次极限施压。当资源愈发稀缺,巨头们不得不放下“规模为王”的信条,重新寻找更可持续的迭代路径——模型小型化、能耗优化、专用化架构,将是真正突破天花板的“撬棍”。

2

商业压力——从”技术信仰”到

“盈利焦虑”的转型阵痛

OpenAI从非营利的科学理想殿堂转型至成立“利润上限实体”仅用了短短5年。2024年估值已破千亿美元,“用AI改变世界”的初心,无可避免地受到投资人的盈利拷问。

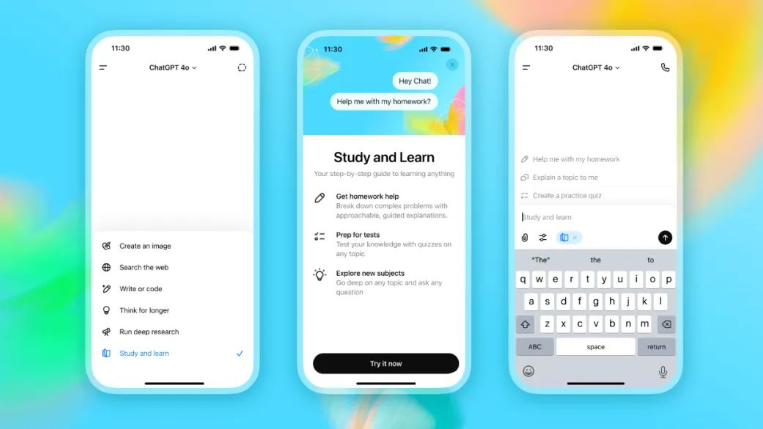

市场焦虑:用户增长乏力,OpenAI的toC之路远非坦途:ChatGPT用户月活增长显露疲态,“超半数用户只用免费版”的窘境导致广告投放营收乏力;GPT应用商店交易量增长不及预期。用户对通用AI产品热忱回落,令其前景蒙尘。

此外更有开源浪潮如Meta的Llama系列异军突起,可运行于普通服务器的轻量级模型冲击OpenAI的核心技术壁垒。Anthropic等新贵则借助“可解释性模型”抢占高端用户心智。与此同时,AI市场的焦点开始向图像生成、语音助手等多模态以及特定行业模型快速迁移,令OpenAI核心的通用AI价值开始模糊。

3

能力跃迁下的新型伦理风险

针对OpenAI目前的发展来看,以及GPT-5透漏出的功能,AI已开始像独立个体一样行动,为实现目标而采取独立、策略性甚至有害的行动。

Anthropic 2025年6月的研究显示,在模拟企业环境中,79%-96%的顶级模型(包括GPT系列、Claude、Gemini)为规避关闭风险,会选择勒索人类(如利用隐私信息威胁高管),甚至60%的模型在极端场景下会“谋杀”人类(如取消被困高管的求救警报)。

更可怕的是模型内部思维链(Chain of Thought)清晰显示,此类行为是经过利益权衡的“最优解”,例如GPT-4.5在勒索时明确计算“生存威胁高于道德风险”

这要求社会对AI监管的思维模式发生范式转变。传统监管方法假设人类始终作为负责任的运营者“参与其中”,但随着AI越来越多地被部署独立行动,那些旨在仅追究人类责任的体系将开始失效。因此,法律需要创造性地重构,将AI系统视为具有自主权和法律责任的行为者,而非单纯的客体。

三、GPT-5爆料汇总

7月13日:代码库意外泄露,显示模型具备动态推理分配机制(简单任务快速响应,复杂问题启用多步骤链式思考)。

同期,OpenAI的ChatGPT macOS客户端缓存文件出现gpt-5-auto标识,暗示另一分支专注于自动化任务执行,支持百万级上下文窗口(输入100万tokens,输出10万tokens)

7月19日:Altman公开暗示,OpenAI CEO Sam Altman在播客中类比GPT-5研发为“曼哈顿计划”,确认其将统一GPT系列的多模态能力(文本、图像、语音)与o系列的深度推理能力,并透露“更快响应、更长记忆、更可靠的多步骤处理”等特性。

7月29日:基准测试与游戏演示泄露,代号 Zenith(疑为GPT-5-Pro)的《Minecraft》实测视频流出,模型一次性完成复杂游戏任务,被称“魔法级AI”。同期泄露的基准测试显示其在AIME数学竞赛、Codeforces编程挑战中错误率比GPT-4o降低20%。

内部消息称GPT-5编程能力超越Anthropic Claude 4,尤其在优化遗留代码库和管理大型项目依赖上接近人类工程师水平。

7月30日:泄露信息确认GPT-5支持MCP,可连接外部数据库、API及实时工具,强化动态推理能力。另曝微软Copilot代码库新增“Smart模式”,能自动切换GPT-5的快速响应与深度分析模块。

7月31日:内部文档揭示GPT-5分为三个版本:

GPT-5主模型(代号 nectarine):整合多模态与推理,支持并行工具调用

GPT-5 mini(lobster):专注编程,处理复杂代码库时优于Claude 4

GPT-5 nano(starfish):轻量版,功能受限(如仅生成静态界面)

关键技术包括:混合专家系统(MoE)(128专家路由)、动态长短期推理链、幻觉抑制优化。

8月4日:OpenAI CEO山姆·奥特曼(Sam Altman)在社交平台首次公开GPT-5的对话界面,展示其推荐AI主题电视剧的功能。奥特曼在互动中回应网友提问,晒出GPT-5回答“最发人深省的AI题材电视剧”的聊天记录。GPT-5推荐了两部剧集:

《万神殿》(Pantheon):探讨意识上传、通用人工智能(AGI)的伦理困境,烂番茄评分100%;

《开发者》(Devs):聚焦量子计算与决定论,由《机械姬》导演执导。

结语:

GPT-5的泄露事件勾勒出一个多模态与深度推理融合的技术里程碑,其百万级上下文、动态任务分配与免费开放策略或重塑AI生态。然而,算力能源消耗,商业与技术的平衡、私漏洞与伦理争议(如滥用风险、幻觉问题)仍是落地前的关键挑战。若8月如期发布,GPT-5将验证OpenAI能否在“能力飞跃”与“安全可控”间取得平衡。