硬件为骨 软件为魂,NVIDIA Jetson Thor加速通用机器人研发部署

我们可以把大语言模型理解为对话,一个可以聊天的机器人,但它的意义不在于聊天,而在于推理,给出对于问题解答的全新视角。

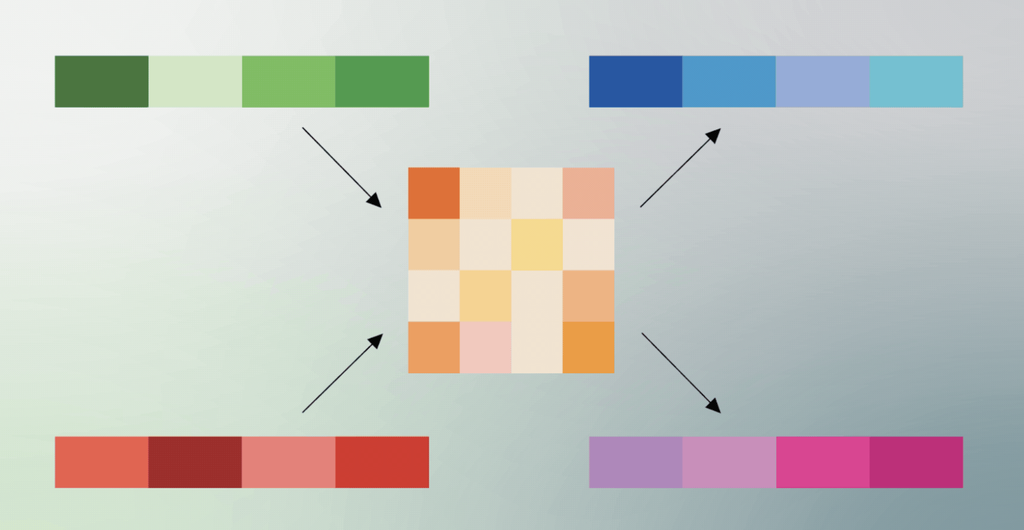

很多人知道LLM(Large Language Model,大型语言模型),但对于VLA(Visual-Language-Action Model,视觉 – 语言 – 动作模型)、VLM(Visual-Language Model,视觉 – 语言模型)就不够熟悉,后者主要应用机器人领域,通过将各种视觉(2048×1536 分辨率)数据、力觉数据(6 轴力反馈)、以及指令语言(100 种指令模板)进行融合,从而完成类似手术辅助机器人、智能牵引车、配送机器人、工业机械臂及视觉 AI 智能体等的应用和操作。

LLM与VLA、VLM的完美融合,为我们展示了推理之外,更为广阔的应用空间。

训练机器人和训练大预言模型对数据内容、以及实时性要求完全不同,其中LLM训练, 99%依赖文本或者多模态数据;相比,机器人70%依赖合成物理数据,30%则来自真实操作示范数据;从特点上看,LLM产出的是没有物理约束的文本序列,会存在幻听;相比机器人,产出的是带有力控参数的系列数据,用于指导机器人的动作;对于性能的要求,二者也存在不同,LLM可接受500ms延迟;但机器人单帧推理延迟要小于8ms;从数据特征上看,LLM所使用的文本数据, token呈现均匀量化离散分布,多采用FP16浮点精度训练模型,相比,机器人训练数据呈非均匀量化(接近零的区域更密集)长尾分布,FP4精度就可以满足训练需求。

根据这些不同的特征,NVIDIA 8月25日宣布发售NVIDIA Jetson AGX Thor 开发者套件和量产级模组,这款专为全球数百万机器人开发者设计、基于 NVIDIA Blackwell 的机器人计算机,可提供高达 2070 FP4 TFLOPS 的计算性能,能高效应对代理式 AI、高速传感器数据处理、通用机器人任务等复杂应用场景。

Jetson Thor 产品系列包含开发者套件与量产级模组。其中,开发者套件包含 Jetson T5000 模组、带有丰富接口的参考载板、带风扇的主动式散热器及电源适配器。它配有NVIDIA Blackwell 架构 GPU、 128 GB 内存,AI 计算性能最高可达 2070 FP4 TFLOPS,用于运行各种面向物理 AI 应用的 AI 软件栈,如面向机器人的 NVIDIA Isaac、面向视觉 AI 智能体的 NVIDIA Metropolis,以及面向传感器处理的 NVIDIA Holoscan等,所有这些都在 130 瓦的功率范围内实现。

NVIDIA 新的Blackwell 架构 GPU引入 MIG 技术,可将单块 GPU 划分为多个相互隔离的实例,每个实例拥有专属资源,可并行运行时间敏感度较低的任务,确保性能的可预测性。新的架构引入原生 FP4 量化技术,并通过搭配下一代 Transformer 引擎,在 FP4 与 FP8 精度之间进行动态切换,追求最优性能。

此外,该模组平台还集成了一整套加速器,包括第三代 Programmable Vision Accelerator(PVA)、双编码器与解码器、光流加速器等。在高速传感器融合方面,提供le 丰富的输入输出(I/O)接口选项,包括 1 个支持 4 路 25GbE 的 QSFP 插槽、1 个有线 Multi-GbE RJ45 接口、多个 USB 端口及其他连接接口。

与 NVIDIA 上一代产品Jetson AGX Orin 相比,新的Jetson AGX Thor平台在 AI 计算性能提高了 7.5 倍,能效提高 3.5 倍。

在软件方面,Jetson AGX Thor平台以 JetPack 7 为核心驱动,搭载 Linux 6.8 内核、Ubuntu 24.04 LTS 操作系统,可支持各类生成式 AI 模型,如NVIDIA Isaac GR00T N1.5 视觉语言动作模型(VLA),也可以涵盖面向视觉 AI 智能体的 NVIDIA Metropolis,以及面向传感器处理的 NVIDIA Holoscan。以Holoscan为例,凭借集成式 Holoscan Sensor Bridge、MIG 支持以及 Preemptable Realtime Kernel 等,从而实现高速传感器融合、运动规划等任务。

开发者还可以借助NVIDIA 的Video Search and Summarization(VSS,视频搜索与总结) 代理式 AI 工作流等,在边缘端构建 AI 智能体。

全新的Jetson AGX Orin与 上一代产品Jetson AGX Orin 相比,AI 计算性能提高至 7.5 倍,能效提高至 3.5 倍。开发者可以在 Orin 上验证算法可行性。例如,斯坦福大学团队用 Orin 训练基础抓取模型,通过 Isaac Sim 仿真生成数据,再将优化后的模型部署到 Thor 上实现实时控制;由于Thor 的 Blackwell 架构支持 FP4 量化和推测解码技术,可加速生成式 AI 模型的推理速度。与 Jetson Orin 相比,其推理速度提升最高达 5 倍。借助 FP4 精度优化与推测解码技术,开发者还能在 Jetson Thor 上进一步实现 2 倍的性能提升。例如,Qwen2.5-VL 模型在 Thor 上的响应速度较 Orin 提升 3 倍,使机器人能实时理解 “将螺丝刀放在工具箱第二层” 等复杂指令。

目前,NVIDIA Jetson AGX Thor 开发者套件现已发售,定价 3499 美元。NVIDIA Jetson T5000 模组也已发售,购买 1000 片以上单价 2999 美元。即刻通过 NVIDIA 授权合作伙伴购买。据了解,面向自动驾驶汽车和移动解决方案的 NVIDIA DRIVE AGX Thor 开发者套件已经开放预订,预计 9 月开始发货。