作为AI技术爱好者和深度使用者,我会付费使用一些最智能的在线AI服务,也特别希望在本地主机上部署更智能的模型。特别是在OpenClaw出现后,巨大的Token消耗量和高昂的成本成功劝退了我,我跟很多人一样,都希望能在本地部署模型。

想要本地部署模型时,最大的问题就是显存不足。最常见的游戏显卡显存以8G为主,已有的英伟达工作站显卡显存大,但成本非常高。几年前开始,英特尔开始推出专业级显卡,其最大的特色就是能以更低的成本提供更大显存,非常适合本地推理。

大显存就是真理,英特尔32G显卡属实把钱配在了刀刃上

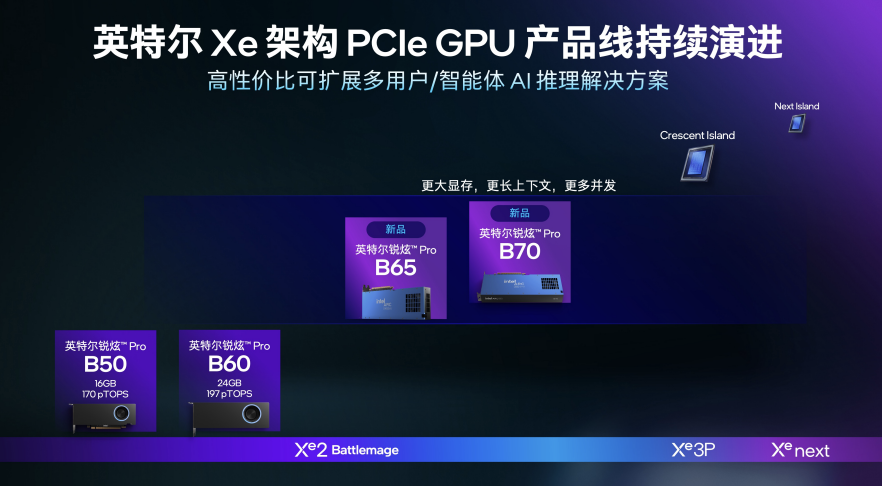

大概三个月前,英特尔刚刚发布了一块24G大显存的锐炫Pro B60。没想到,4月23日,英特尔又官宣了锐炫Pro B70,显存来到了惊人的32GB。英特尔中国区显卡和AI高级产品总监徐金平在采访中透露称,下一代产品会比这个显存还要大很多很多。

要知道,去年下半年以来,HBM和DDR5价格一路狂飙,大显存显卡价格水涨船高,连改装显存的二手显卡都疯狂涨价。这个时候有一张原生32G、价格还更低的卡出来,对那些每天都在被显存折磨的人来说,是件实打实的好事。

关于这张B70显卡的技术参数本身我不想说太多。对比上一代的B60,显存容量提升33%,显存带宽提升了50%(608GB/s),位宽256 bit。算力提升86%,其中,FP32算力精度下能达到22.94 TFLOPS,Int8精度下最高367 TOPS。

得益于大显存、高显存带宽的特点,B70非常适合长上下文、多并发场景。与B70一起发布的,还有B65,两者在显存容量、带宽上完全一样,B65的算力和B60一致,而价格比B70更加亲民,也会成一个非常有竞争力的大显存产品。

英特尔中国区技术部总经理高宇表示,B65的价格肯定比B70更便宜,但是又保存了32GB大显存的特色,所以对有一些需要大显存、但是不那么需要高算力、对价格又比较敏感的用户,就非常适合。

总之,英特尔锐炫Pro B70专业显卡的定位和优势非常明显,接下来聊一聊,用户都在用B70在做什么,生态情况如何,用起来怎么样?这对于想本地部署AI大模型的个人和部分企业用户更有参考价值。

用32G的B70跑OpenClaw用的模型,喂饱你的小龙虾

我在2026年1月底就用上了OpenClaw,它的能力确实很强,但简单聊几句话就能消耗几十块钱,再多聊几句额成本还会继续狂飙,这么高的成本用起来确实有压力。于是,我不得不节衣缩食,惜字如金的用。

发布会现场,英特尔技术专家王巍巍演示了一个B70单卡支撑长上下文智能体的场景。一台酷睿Ultra个人工作站,配单张B70,跑Qwen3.5-35B A3B模型续写小说。先后测试了128K和256K上下文,32G的显存占用仍有不少余量,任务可以轻松跑完。

大显存带来的显存余量很重要,因为智能体工作时,上下文窗口里堆积的工具调用记录、文件内容、多轮交互历史很多,会占用很多显存。想要在本地跑OpenClaw这类智能体的个人用户,如果用酷睿Ultra搭配一张B70,云端Token账单可以省下来了。

这只是B70单卡的效果,如果工作站里放四张B70,配上新发布的至强600工作站处理器,则可以部署Qwen3-Coder-Next-80B模型。有人说,这模型也不大啊,但是,它刻蚀能支持同时部署24个OpenClaw智能体,提供很强的并发能力的。

24个并发是什么概念?现场演示让这台机器同时盯24只个股,每10秒跑一轮迭代,过去一个分析师团队要忙好几天的活儿,这台工作站几个小时就能把整个市场所有个股全部分析一遍,可以给投资者的投资决策提供一手消息。

总之,如果普通人选择B70这样的卡,就可以无压力地用上本地模型来给OpenClaw提供无限量的Token,真正喂饱你的小龙虾。

知名自媒体大V也在用B70控制成本,提高效率

除了用来跑OpenClaw这类智能体,Pro B70被用于车圈自媒体大V韩路的内容生产流程中。据韩路介绍,其公司有3PB的视频素材,内容多种多样,找起来会比较麻烦,他们把这些数据交给了AI,让锐炫Pro B70推理模型来理解这些素材。

当模型学习了这些素材后,只需要用自然语言说:“我需要有雪山、有大山大河、有绿树的素材”,AI很快就能找到所对应的素材,能大大提高工作效率。下一阶段,韩路希望能在本地进行文生图,图生视频,希望用本地推理方案降低成本。

韩路在发布会上讲了一句话让人印象深刻,他说,“任何企业都会重视效率和收入,在他看来,投资设备、投资硬件是最便宜、最廉价的增效办法。这就是愿意和英特尔合作,利用最前沿设备提高效率的原因。”

联想基于联想自研的智能会议解决方案,构建了一套面向企业的本地化AI会议系统。该方案以英特尔酷睿Ultra平台为基础,搭载B70,在本地运行40亿参数大模型,实现了会议语音实时转写、多语言翻译以及会后自动生成会议纪要等核心能力。

在实际能力上,单张B70显卡即可支撑约20路会议室并发接入,覆盖数十人规模的日常会议场景。这意味着企业无需依赖云端,也能得稳定、低延迟、数据可控的智能会议体验,对于不想用云方案,担心隐私泄露的企业非常有吸引力。

经验证,B70多卡方案已被用于企业生产场景

杭州飞致云基于其开源的企业级智能体开发平台MaxKB,完成了B70的多卡部署与实测验证,证明了B70所提供的并发能力、上下文长度和响应时效,完全能满足企业应用场景的需求。

具体来看,飞致云通过2卡、4卡、8卡的不同组合,分别推理不同参数和上下文的大模型,实现了20–30路并发(2卡/4卡)以及50+并发(8卡)的能力,同时保持约15 TPS的稳定响应速度,测试的场景覆盖大多数企业的应用场景。

杭州飞致云信息科技有限公司北区副总经理施慧斌表示,“锐炫Pro B70在硬件成本非常可控的情况下,帮我们成功在8卡的配置下,轻松应对50以上的并发。过去要做到这点,硬件投入要翻倍。”

东华医为基于8卡的B70,在智慧医疗场景中完成了电子病历智能体AI解决方案的落地验证。其场景覆盖病历生成、病历内涵质控(检查病历写得合不合理)、临床辅助决策等核心诊疗环节,这些是每一家医院的刚需系统。

相比上一代方案,B70将病历辅助生成效率提升约8倍,病历内涵质控能力提升约67%,同时在整机成本基本可控的前提下,实现了更高的单机并发能力。测试数据显示,两到三套8卡B70方案就能满足一个中等规模医院的病历智能体的需求。

东华医为AI研发总监侯建表示,之所以看好英特尔锐炫PRO产品系列,一方面是因为其生态完善,对于模型、推理框架的支持非常好;二是因为有非常出色的性价比;三是在近期测试B70的时候,看到了单服务器并发性能的巨大提升。

本地推理和云服务不是对立关系,而是互补

我个人非常关注本地推理AI模型这件事,这种方式不仅成本低,而且能彻底避免隐私泄露,而且它能提供更高的确定性。讲了这么多本地部署的故事,或许会让人误以为本地部署和云上推理是对立的,事实上,云上和本地是可以互补的关系。

AgentSphere火山引擎推出的企业AI统一工作台,当一家公司的智能体太多时,可以用它来降低企业的管理负担。它不仅能用来进行多智能体纳管协同,也可以用它来以MCP的方式集成存量的业务系统。

火山引擎AgentSphere产品高级经理刘嘉鹏在介绍AgentSphere平台时提到,结合B70等本地算力,AgentSphere构建了本地+云的混合部署模式:敏感数据处理、高频推理在本地完成,复杂模型调用按需上云,从而在性能、成本与数据安全之间取得平衡。

徐金平在采访中提到,用户用Openclaw的时候经常遇到云端服务不能访问的情况,如果未来企业要在生产环境使用智能体,很多企业会自己部署,自己部署的话完全可以保证服务的质量。