今日,摩尔线程在其旗舰级AI训推一体全功能GPU MTT S5000上,成功实现了对智谱新一代旗舰模型GLM-5.1的Day-0极速适配,提供推理部署和训练复现全流程支持。

依托MUSA软件栈强大的生态兼容性,摩尔线程技术团队基于高性能 SGLang-MUSA推理引擎及TileLang-MUSA算子编程语言,采用PD分离架构完成深度调优,在 MTT S5000 上实现 GLM-5.1 的高效、高精度推理。这一成果彰显了国产算力基础设施对前沿 SOTA 模型的快速响应能力,也为行业树立了软硬协同应对复杂 AI 推理场景的新标杆。

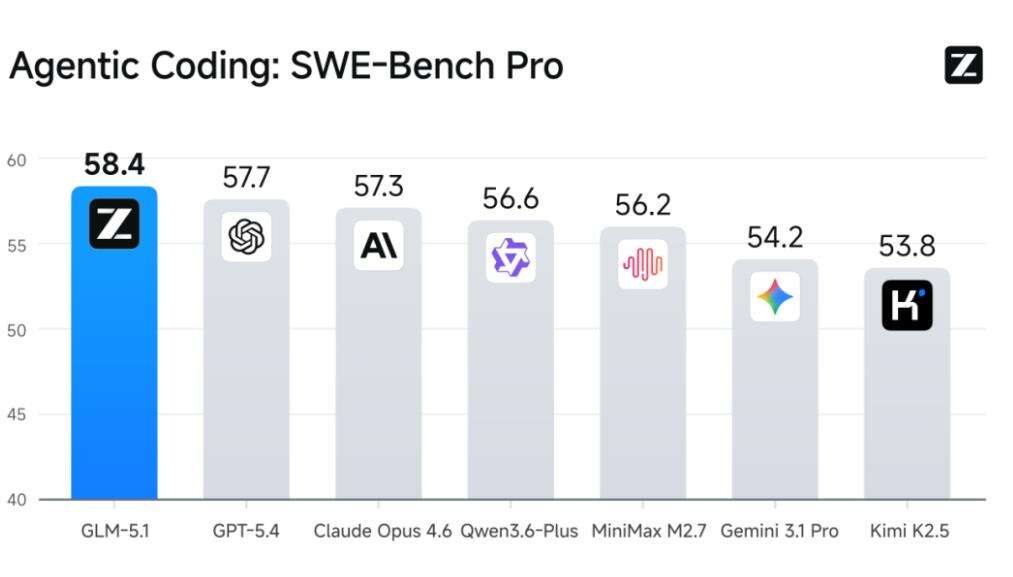

GLM-5.1是智谱迄今最智能的旗舰模型,也是目前全球最强的开源模型。GLM-5.1大大提高了代码能力,在最接近真实软件开发的SWE-bench Pro基准测试中超过GPT-5.4、Claude Opus 4.6,刷新全球最佳成绩。值得一提的是,在模型整体性能大幅提升外,GLM-5.1还在长程任务(Long Horizon Task)处理能力上实现了显著突破。和当前分钟级交互的模型不同,GLM-5.1能够在一次任务中独立、持续工作超过8小时,期间自主规划、执行、自我进化,最终交付完整的工程级成果。

针对GLM-5.1的长程任务与代码生成特性,摩尔线程基于自研MUSA架构与SGLang-MUSA、TileLang-MUSA等关键技术,完成了系统性的算子适配与推理性能调优。MTT S5000单卡AI算力(稠密)可达1000 TFLOPS,支持FP8到FP64全精度计算,其原生FP8加速显著提升推理效率;结合高效KV Cache管理,有效支撑极长上下文的显存需求;同时,PD分离架构进一步解耦Prefill与Decode阶段,降低长序列生成中的干扰,保障持续任务的高吞吐与低延迟。此外,MTT S5000提供784GB/s的卡间互联带宽,为大规模部署带来弹性扩展能力。通过软硬协同优化,MTT S5000能够稳定承接GLM-5.1的长程任务吞吐与工程级代码推理表现。

从GLM-4.7到GLM-5.1,摩尔线程已连续实现发布当日极速适配。这既体现了MUSA架构对主流AI生态的深度兼容,更标志着国产全功能GPU已具备大模型“从适配到部署”的全链路支撑能力。摩尔线程将持续夯实算力底座,助力开发者快速应用前沿模型,共建更成熟的国产AI生态。