中国联通数据科学与人工智能研究院科技创新成果近日再度取得突破,提出并开源全新扩散模型加速框架LeMiCa(Lexicographic Minimax Path Caching),得到学术界认可,入选国际人工智能顶会NeurIPS 2025 Spotlight(全球超过2万篇投稿中,仅3.1%入选)!不仅如此,还获得了通义千问和智谱AI的倾情推荐,分别在其官方主页上对LeMiCa进行展示!

NeurIPS(Conference on Neural Information Processing Systems,神经信息处理系统大会),是全球机器学习和人工智能领域最具影响力的学术会议之一,CCF-A类会议。内容涵盖人工智能领域的机器学习、深度学习、计算机视觉、自然语言处理、AI for Science等多个领域方向。该会议由NIPS基金会主办,始于1987年。NeurIPS的论文录取率在20%-25%左右,spotlight的录取率在3%-4%左右。

(论文入选)

(QWen-Image)

(智谱AI CogVideoX)

多模态生成模型“快”与“精”的两难

当前,以谷歌 Nano-Banana、OpenAI Sora2 等为代表的文生图、文生视频模型正快速发展,但仍面临“快”与“精”的两难:快了质量差,精了速度慢,影响规模化应用。

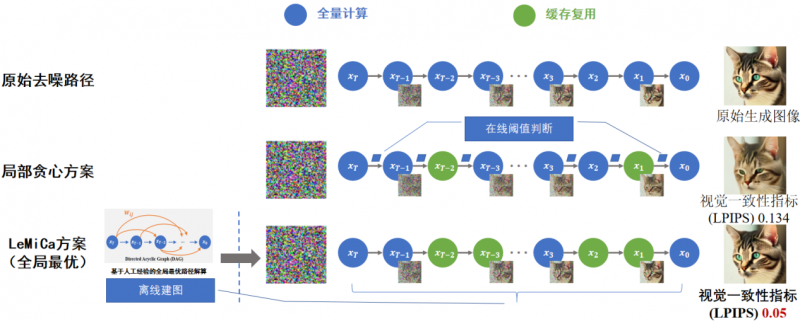

广泛使用的扩散模型(Diffusion Model)架构通过多步迭代采样去噪生成内容,每步都需全量计算,导致生成耗时长、成本高。业界主流的局部贪心缓存(Local-Greedy Caching)优化方案,通过在线计算和阈值判断实现缓存复用,精简全量计算,但因只关注局部,采用“走一步看一步”策略,导致累积误差,生成内容失真。

LeMiCa通过全局优化突破两难瓶颈

中国联通数据科学与人工智能研究院推出的LeMiCa方案,通过融合人工经验与数据驱动的创新方法论,将推理速度提升 2 倍以上,同时保持高质量生成效果。

LeMiCa以全局视角优化生成路径,最大限度减少累积误差。研究院通过大量实验发现,原始迭代采样步骤具有可复用性,且蕴含可跨不同提示词的全局规律,因此提出通过人工经验离线解算全局最优路径,与数据驱动的模型在线推理相结合,在不额外增加推理耗时的前提下,实现高效加速。

LeMiCa 相当于具备全局调度能力的“导演”,在提升生成速度的同时保持画面质量、风格与细节的高度一致与连贯。

( LeMiCa 核心算法图示)

实验证实:近乎无损加速

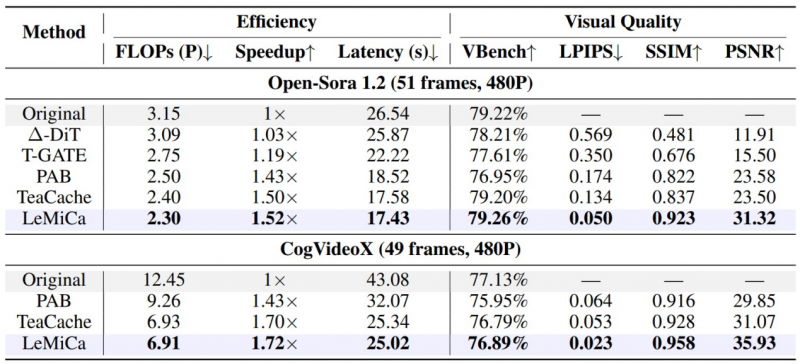

视频生成:在Open-Sora 、 CogVideoX等多项主流视频生成模型上,在相近加速比下,LeMiCa生成的视频在LPIPS、SSIM和PSNR等指标上均显著超越主流方法,视频质量无限接近原始视频,实现高质量加速,如下图。

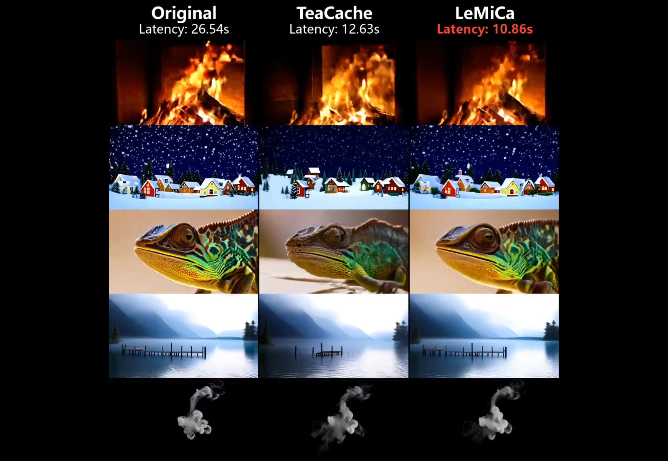

在生成效果对比上,LeMiCa 仅用 10.86s 即可接近原始方法耗时26.54s生成的效果,质量明显高于耗时接近的其他方案,体现出在算效比上的突出优势。

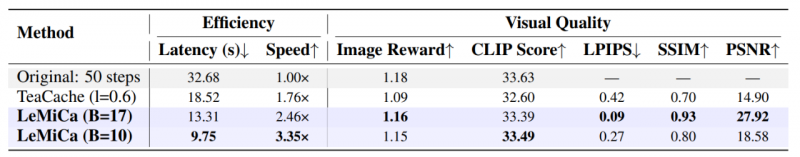

图像生成:LeMiCa 的加速理念同样适用于文生图任务,研究院在顶级开源模型 Qwen-Image 上实现高效推理适配。在生成速度提升 3 倍的情况下,图像质量与语义一致性指标接近原始模型,并且加速性能与图片质量均显著优于主流方法,充分验证了 LeMiCa 的通用性与高性能,如下图。

(LeMiCa为Qwen-Image提供高效推理加速)

这些实验结果验证了LeMiCa在多模态生成任务的高效推理加速能力,可以用极低成本来直接对接现有的模型架构。这意味着,无论是图片艺术创作、AIGC视频平台、数字人生成,还是工业设计、文创短片等场景,都可以轻松接入LeMiCa,实现低成本提速和高质量生成。

LeMiCa现已全面集成至联通元景MaaS平台,支撑文生图、图像编辑、文生视频等多项模型服务,并在文创、品宣等多个行业场景中落地应用。