Google DeepMind公布可在机器人端执行的Gemini模型,无需网络也能运行。Google DeepMind部门本周公布了一款可在机器人上运行的Gemini Robotics On-Device模型,该模型无需网络连接即可运行,并且具备高度的任务泛化能力。

图片来自网络

今年3月,Google介绍了一款视觉语言动作(Vision Language Action,VLA)模型,将Gemini 2.0的多模态推理和现实世界理解能力引入机器人领域。本周,Google DeepMind进一步公布了Gemini Robotics On-Device,这是该公司可以直接在机器人上运行的最强大的模型。由于Gemini Robotics On-Device的运行不依赖网络连接,因此它适合对延迟敏感的应用程序,即使在带宽不稳定甚至没有网络的地区也能稳定运行。

Gemini Robotics On-Device是双臂机器人的基础模型,仅需最少的计算资源。它基于Gemini Robotics的任务泛化和灵活性开发。Google强调,该模型的设计宗旨是快速实验和灵活操作,能够通过微调适应新任务,并且可以在本地执行低延迟推理。

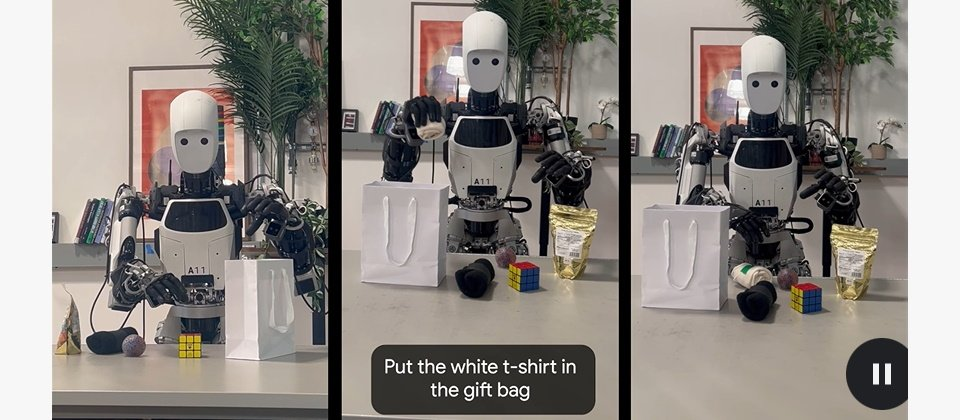

Gemini Robotics On-Device在多种测试场景中展示了强大的视觉、语义和行为泛化能力,超越了Gemini Robotics和其他设备上运行的模型。它能够遵循自然语言指令,通过在机器人端执行来完成高难度任务,例如解开袋子的拉链或折叠衣服。

Gemini Robotics On-Device也是Google首个开放微调的VLA模型。即使在未微调的情况下,它也能执行许多任务,但开发人员仍然可以对其进行微调以适应新领域。在微调过程中,开发人员只需提供50到100次示例。

Gemini Robotics On-Device是基于ALOHA机器人进行训练的,但Google已经展示了经过微调后,它也可以在第三方厂商的机器人上运行,例如德国Apptronik的Franka FR3双臂工业机器人或Apollo人形机器人。

Google还发布了Gemini Robotics SDK,帮助开发人员评估Gemini Robotics On-Device在其环境或任务中的性能。他们还可以利用Google几年前发布的MuJoCo物理模拟库测试模型,并快速适应其他新领域。开发人员现在只需报名加入可信测试员计划即可访问SDK。